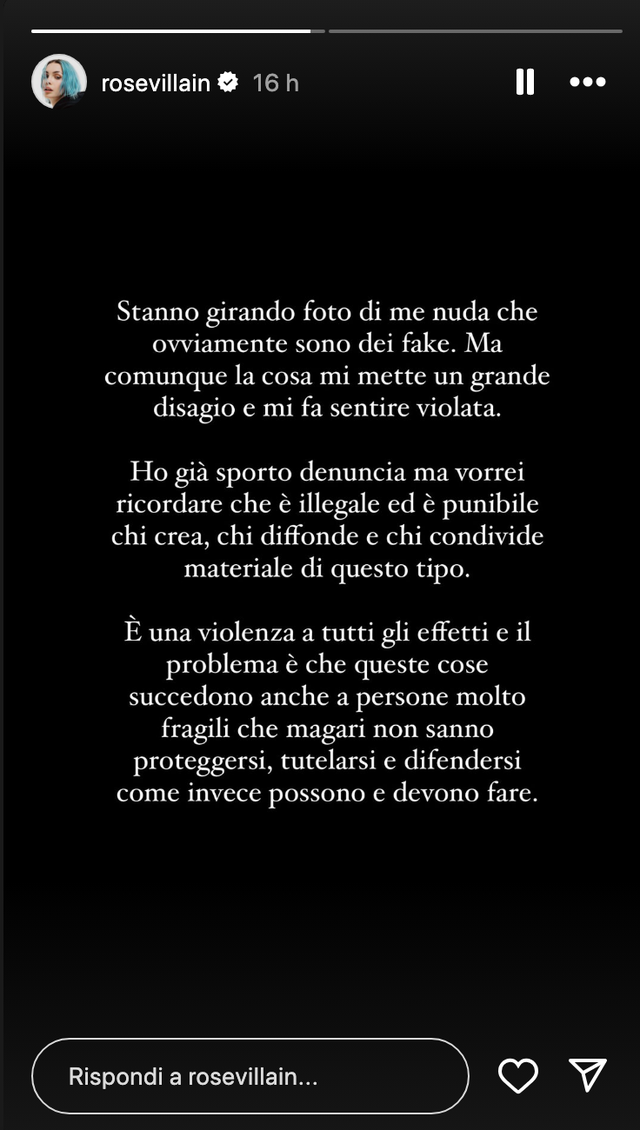

Da poco era successo anche a Rosalía, ma i casi si stanno diffondendo sempre di più. Questa volta è stata Rose Villani a denunciare su Instagram la diffusione di foto intime deepfake che la ritraggono. «Stanno girando foto di me nuda che ovviamente sono dei fake», ha scritto la cantautrice di "Click Boom!" nelle stories. Questo genere di immagini sono il risultato delle creazione artificiale di foto di nudo o pornografiche dove figura il volto delle persone colpite, mentre il corpo è stato "spogliato" tramite l'intelligenza artificiale o sostituito con quello di attori porno. «La cosa mi mette un grande disagio e mi fa sentire violata», ha scritto l'artista, «Ho già sporto denuncia ma vorrei ricordare che è illegale ed è punibile chi crea, chi diffonde e chi condivide materiale di questo tipo».

La creazione di questo tipo di contenuti può partire da normalissime foto pubblicate online come nel caso di Rosalía ma anche di Taylor Swift e molte altre. È qualcosa che può avvenire manualmente tramite programmi di foto ritocco, ma oggi è sempre più frutto dell'intelligenza artificiale, in grado di creare con grandissima facilità immagini sempre più credibili rielaborando delle fotografie fornite in partenza. Si tratta di una vera e propria forma di violenza tramite immagini e succede alle star ma anche alle persone comuni, soprattutto donne. Nel 2020 ha fatto parlare il caso di Helen Mort poetessa e scrittrice britannica che ha scoperto che qualcuno aveva caricato su un sito porno delle suo foto prese da Instagram (foto qualsiasi, della vita di tutti i giorni) chiedendo che venissero trasformate in deepfake. Cercandole online Mort aveva trovato riproduzioni di «atti sessuali violenti mostrati con la mia faccia photoshoppata sul corpo della donna. Immagini degradanti, un'immagine di me strangolata, così realistica che se fosse stato un estraneo a vederla, non avrebbe mai potuto dire con certezza che fosse un falso».

Casi simili sono sempre più comuni e Rose Villain ha pubblicato nelle stories alcuni screenshot di articoli che parlano proprio del dilagare del deepfake porn. «È una violenza a tutti gli effetti», ha scritto sui social», «e il problema è che queste cose succedono anche a persone molto fragili che magari non sanno proteggersi, tutelarsi e difendersi come invece possono e devono fare».